Puntos de fuga de artistas renacentistas mejoran vehículos autónomos

Una nueva inteligencia artificial ayuda a vehículos autónomos a percibir el entorno. Utilizando el concepto de punto de fuga, mejora la comprensión espacial y la detección de objetos distantes.

27/10/2025 | 22:59Redacción Cadena 3

Una tecnología de inteligencia artificial (IA) fue desarrollada para permitir que vehículos autónomos basados en cámaras perciban su entorno con mayor precisión. Este enfoque innovador utiliza el concepto geométrico del punto de fuga, un recurso artístico que transmite profundidad y perspectiva en imágenes.

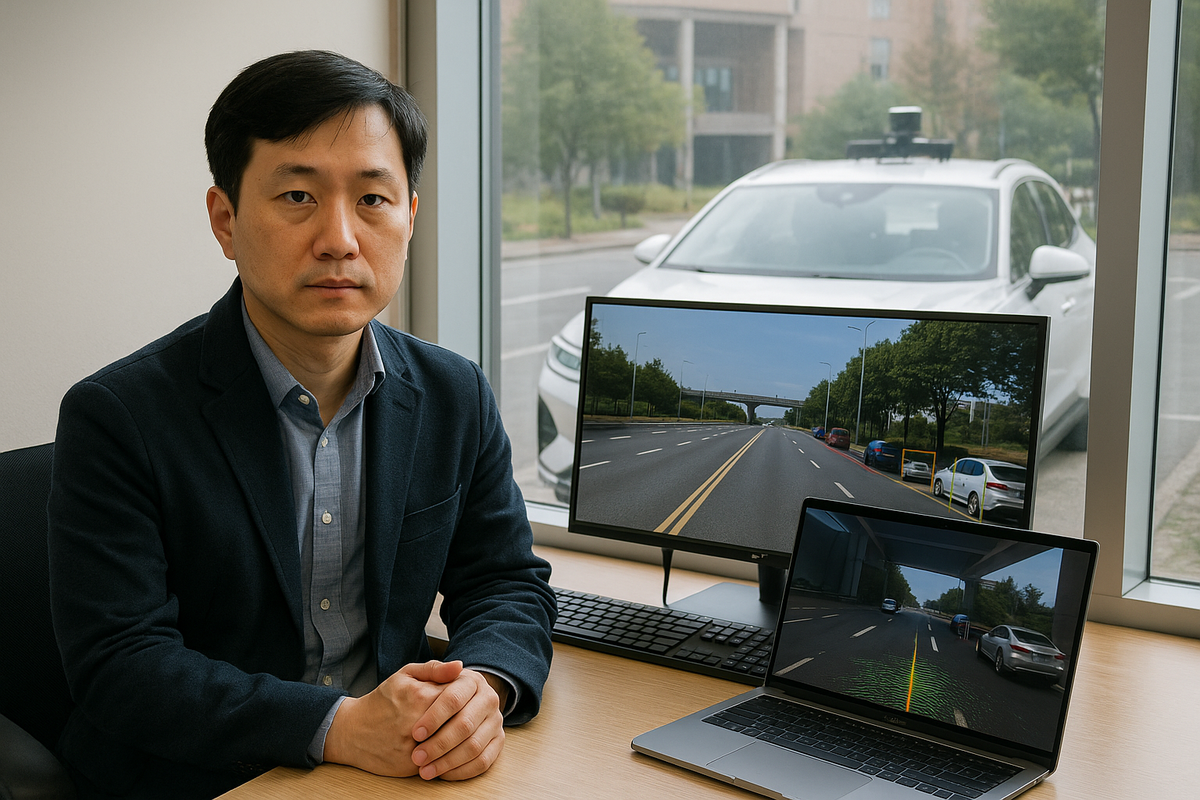

El profesor Kyungdon Joo y su equipo de investigación de la Escuela de Graduados de Inteligencia Artificial en la UNIST anunciaron el desarrollo de VPOcc, un nuevo marco de IA que aprovecha el punto de fuga para mitigar la discrepancia entre 2D y 3D tanto a niveles de píxel como de características. Este enfoque aborda la distorsión de perspectiva inherente a las entradas de cámaras, posibilitando una comprensión de escena más precisa.

Los vehículos y robots autónomos reconocen su entorno principalmente a través de cámaras y sensores LIDAR. Aunque las cámaras son más asequibles, ligeras y capaces de captar información rica en color y forma en comparación con LIDAR, también introducen problemas significativos debido a la proyección del espacio tridimensional en imágenes bidimensionales. Los objetos más cercanos a la cámara aparecen más grandes, mientras que los distantes parecen más pequeños, lo que puede llevar a errores, como no detectar objetos lejanos o enfatizar en exceso las regiones cercanas.

Para abordar este desafío, el equipo de investigación diseñó un sistema de IA que reconstruye la información de la escena basándose en el punto de fuga, un concepto establecido por pintores renacentistas para representar profundidad y perspectiva, donde líneas paralelas parecen converger en un solo punto en la distancia. Así como los humanos perciben la profundidad al reconocer puntos de fuga en un lienzo plano, el modelo de IA desarrollado utiliza este principio para restaurar más precisamente la profundidad y las relaciones espaciales en las imágenes capturadas por la cámara.

El modelo VPOcc consta de tres módulos clave. El primero es VPZoomer, que corrige la distorsión de perspectiva deformando imágenes en función del punto de fuga. El segundo es atención cruzada guiada por VP (VPCA), que extrae información equilibrada de regiones cercanas y lejanas a través de una agregación de características consciente de la perspectiva. El tercero es una fusión de volumen especial (SVF), que fusiona imágenes originales y corregidas para complementar las fortalezas y debilidades de cada una.

Los resultados experimentales demostraron que VPOcc supera a los modelos existentes en múltiples benchmarks tanto en comprensión espacial (medido por la intersección sobre la unión media, mIoU) como en precisión de reconstrucción de escena (IoU). Notablemente, predice de manera más efectiva objetos distantes y distingue entidades superpuestas, capacidades cruciales para la conducción autónoma en entornos de carreteras complejos.

Esta investigación fue liderada por el primer autor Junsu Kim, un investigador de UNIST, con contribuciones de Junhee Lee en UNIST y un equipo de la Universidad Carnegie Mellon en Estados Unidos. Junsu Kim explicó que "integrar la percepción espacial humana en IA permite una comprensión más efectiva del espacio 3D. Nuestro enfoque fue maximizar el potencial de los sensores de cámara, más asequibles y ligeros que LIDAR, abordando sus limitaciones de perspectiva inherentes".

El profesor Joo agregó que "la tecnología desarrollada tiene amplias aplicaciones, no solo en robótica y sistemas autónomos, sino también en mapeo de realidad aumentada (AR) y más allá".

El estudio recibió el Premio de Plata en el 31º Premio Samsung Human Tech Paper en marzo y ha sido aceptado para presentación en IROS 2025 (Conferencia Internacional sobre Robots y Sistemas Inteligentes). El artículo está disponible en el servidor de preimpresión arXiv.

Lectura rápida

¿Qué tecnología fue desarrollada?

Una inteligencia artificial llamada VPOcc que utiliza el punto de fuga para mejorar la percepción 3D de vehículos autónomos.

¿Quién lideró la investigación?

La investigación fue liderada por Junsu Kim de la Universidad Nacional de Ciencia y Tecnología de Ulsan.

¿Cuándo y dónde fue presentada la investigación?

El estudio fue presentado el 27 de octubre de 2025 y recibirá el Premio de Plata en la conferencia IROS 2025.

¿Cómo afecta este desarrollo a los vehículos autónomos?

La tecnología mejora la detección de objetos lejanos y la comprensión espacial, crucial para la conducción autónoma.

¿En qué otros campos puede aplicarse esta tecnología?

Además de la robótica, puede aplicarse en mapeo de realidad aumentada (AR) y otras áreas.